DeepSeek czy ChatGPT: które narzędzie AI lepiej chroni dane?

Duże modele językowe (LLM – z ang. Large Language Models) są już stałym elementem codzienności dla milionów ludzi. Narzędzia takie jak ChatGPT i DeepSeek zajmują się obecnie wszystkim – od odpowiadania na zwykłe pytania po przeprowadzanie badań rynku i obsługę wewnętrznych przepływów pracy.

Ale co tak naprawdę dzieje się z danymi, które udostępniamy chatbotom wykorzystującym sztuczną inteligencję?

Postanowiliśmy dokładnie przyjrzeć się politykom prywatności i warunkom użytkowania ChatGPT i DeepSeek, aby ustalić, w jaki sposób poszczególne platformy gromadzą, przechowują i wykorzystują dane użytkowników, a także jak przekłada się to na bezpieczeństwo plików i ochronę prywatności w praktyce.

Dlaczego bezpieczeństwo danych i ochrona prywatności mają tak istotne znaczenie przy wyborze narzędzia AI?

Przy wyborze narzędzia wykorzystującego sztuczną inteligencję kluczową kwestią jest prywatność danych. Warto pamiętać, że w określonych przypadkach model może rejestrować, gromadzić i wykorzystywać dane wprowadzane przez użytkowników do celów szkoleniowych i zapewniania jakości. Prompty procesowane są w infrastrukturze obsługiwanej przez dostawcę, która pozostaje poza kontrolą użytkownika i podlega zasadom przetwarzania danych platformy.

Ryzyko wzrasta, gdy zaczynamy używać AI w codziennej pracy. Użytkownicy korzystają z chatbotów AI do prywatnych potrzeb, np. planowania budżetu, podejmowania decyzji zawodowych i zadawania pytań na temat zdrowia, a także do celów zawodowych, np. tworzenia dokumentacji firmowej, przeglądania kodu, planowania strategicznego i nie tylko. Tego rodzaju dane mogą mieć poufny charakter i nie powinny być wykorzystywane przez firmy oferujące narzędzia AI do szkolenia modeli.

Decydując się na określony model sztucznej inteligencji, należy wziąć pod uwagę nie tylko jakość i szybkość odpowiedzi, ale także na poziom zabezpieczeń i ochrony prywatności. Konkretne praktyki przetwarzania danych różnią się w zależności od dostawcy, abonamentu i ustawień użytkownika – istotne jest na przykład, czy prompty są zachowywane, przeglądane lub wykorzystywane do ulepszania modelu. Warto zadać sobie następujące pytania:

- „Kto ma dostęp do moich danych?”

- „W jakich sytuacjach mogą one zostać wykorzystane ponownie?”

- „Na ile mogę zweryfikować, co dzieje się po przesłaniu zapytania?”

W jaki sposób DeepSeek i ChatGPT przetwarzają dane użytkowników?

Dane wprowadzone do ChatGPT lub DeepSeek przetwarzane są w kilku etapach. To, w jaki sposób te informacje są wykorzystywane, zależy od polityki prywatności i warunków użytkowania usługi.

W praktyce obsługa danych obejmuje trzy elementy:

- Sposób przetwarzania i rejestrowania promptów.

- To, czy wprowadzone dane mogą zostać wykorzystane do czegoś więcej poza udzielaniem odpowiedzi.

- Długość przechowywania informacji w systemach dostawcy.

Gromadzenie danych i rejestrowanie poleceń

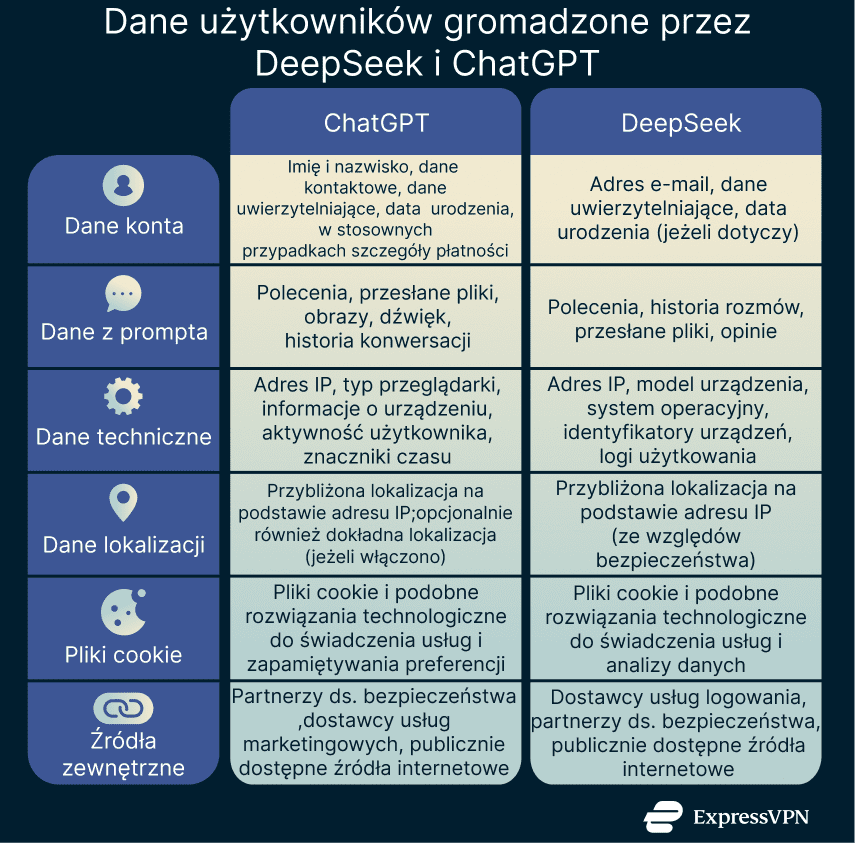

ChatGPT i DeepSeek zbierają dane użytkownika w ramach świadczenia usług. Obejmuje to informacje podawane przez użytkownika, dane generowane w wyniku interakcji z platformą oraz parametry techniczne automatycznie zbierane tle.

DeepSeek

DeepSeek gromadzi dane osobowe, gdy zakładasz konto, wprowadzasz prompty, przesyłasz pliki lub w inny sposób wchodzisz w interakcję z usługą. Obejmuje to dane konta, np. adres e-mail, nazwę użytkownika i hasło, a także treść konwersacji, np. polecenia, historię czatów, opinie i przesłane materiały.

Usługa gromadzi również informacje o urządzeniu i sieci, takie jak adres IP, identyfikatory urządzeń, system operacyjny, język systemu, dzienniki wydajności i raporty o awariach. DeepSeek przypisuje urządzeniom i użytkownikom identyfikatory w celu monitorowania aktywności między sesjami i na różnych sprzętach do celów operacyjnych i związanych z bezpieczeństwem. Firma rejestruje również to, w jaki sposób użytkownicy wchodzą w interakcje z funkcjami, a ponadto zapisuje przybliżoną lokalizację na podstawie adresu IP ze względów bezpieczeństwa oraz wykorzystuje pliki cookie i podobne technologie do świadczenia usług i analizowania ich jakości.

W polityce prywatności DeepSeek zaznaczono również, że serwis może otrzymywać dane osobowe od stron trzecich, np. dostawców usług logowania, partnerów ds. bezpieczeństwa i publicznie dostępnych źródeł internetowych. DeepSeek oświadcza, że usługa nie została zaprojektowana do przetwarzania wrażliwych danych osobowych. Firma wyraźnie ostrzega użytkowników, aby nie przesyłali takich informacji.

ChatGPT

ChatGPT gromadzi dane osobowe, kiedy zakładasz konto, wprowadzasz prompty, przesyłasz treści lub komunikujesz się z OpenAI. Obejmuje to informacje związane z kontem, takie jak Twoje imię i nazwisko, dane kontaktowe, dane logowania oraz, w stosownych przypadkach, informacje dotyczące płatności. Treści użytkownika obejmują polecenia, przesłane pliki, obrazy i pliki audio, w zależności od wykorzystywanych funkcji.

OpenAI w swojej polityce prywatności informuje również, że gromadzi dane techniczne generowane podczas korzystania z usługi, takie jak adres IP, typ przeglądarki, znaczniki czasu, logi interakcji, schematy użytkowania, informacje o urządzeniu i ogólna lokalizacja wywnioskowana z adresu IP. Wymienione parametry umożliwiają świadczenie usług, monitorowanie zabezpieczeń i optymalizację wydajności. Pliki cookie i pokrewne technologie służą do zachowywania preferencji i poprawy komfortu użytkowania.

Dodatkowo, OpenAI otrzymuje dane od zaufanych partnerów, np. dostawców usług bezpieczeństwa i marketingu, a także deklaruje, że pozyskuje publicznie dostępne informacje z Internetu na potrzeby rozwijania modeli wykorzystywanych w świadczonych usługach.

Wykorzystanie danych użytkownika do szkolenia modeli

Prompty użytkowników służą nie tylko do generowania odpowiedzi; w niektórych przypadkach mogą być dodatkowo zapisywane i analizowane na potrzeby dalszego ulepszania modelu AI.

DeepSeek

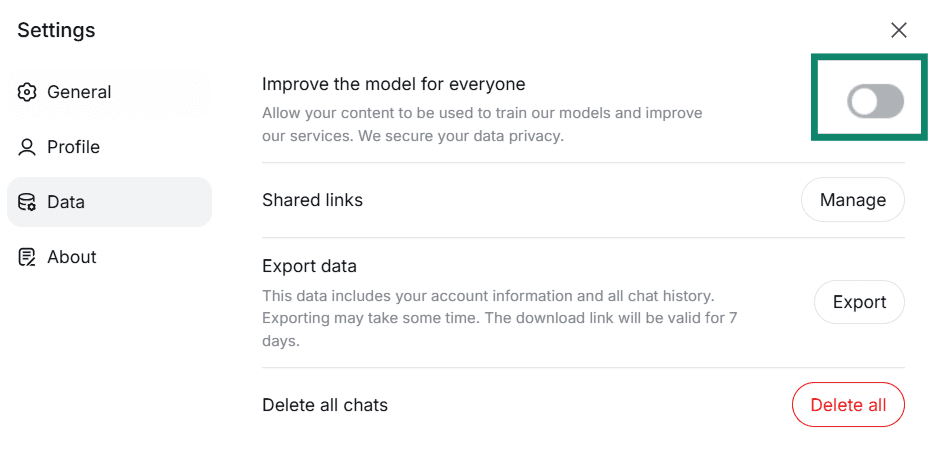

DeepSeek przetwarza dane użytkowników na potrzeby świadczenia i ulepszania usług, co może obejmować rozwijanie modeli. Tak jak w przypadku ChatGPT możesz zrezygnować z udostępniania treści do celów szkoleniowych, otwierając Settings (Ustawienia) i wyłączając opcję Improve the model for everyone (Ulepsz model dla wszystkich) w sekcji Data (Dane).

ChatGPT

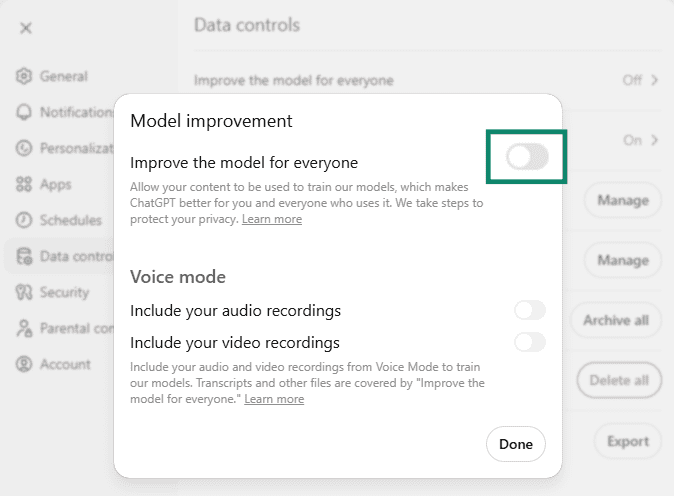

Na potrzeby zapewniania jakości i odpowiedniego poziomu ochrony ChatGPT może stosować dwie formy analizy: automatyczną i ręczną (prowadzoną przez pracownika). Pamiętaj, że możesz wprowadzić zmiany, przechodząc do Settings (Ustawienia) > Data Controls (Kontrolki danych), a następnie dezaktywując opcję Improve the model for everyone (Ulepsz model dla wszystkich). Dzięki temu ChatGPT nie będzie mieć możliwości wykorzystania Twoich danych na potrzeby szkolenia modelu. Warto jednak pamiętać, że ta zmiana wpłynie wyłącznie na przyszłe prompty – wcześniej zebrane dane zostaną zachowane, a poza tym historia czatu może zostać wykorzystana w innych celach, np. do prowadzenia dochodzenia w przypadku naruszenia bezpieczeństwa.

Kontrola nad przechowywaniem i usuwaniem danych

Zarówno DeepSeek, jak i ChatGPT przechowują dane osobowe dla celów operacyjnych, prawnych i związanych z bezpieczeństwem – jednak zakres gromadzonych informacji i opcje kontroli oddane w ręce użytkownika różnią się w praktyce.

DeepSeek

DeepSeek przechowuje dane osobowe tak długo, jak jest to konieczne do świadczenia usług i wypełniania zobowiązań prawnych, biznesowych i umownych. Przeważnie przechowuje informacje o koncie, dane wprowadzane przez użytkownika oraz dane rozliczeniowe przez cały okres ważności konta. Jeśli użytkownik naruszy zasady platformy, DeepSeek może zachować stosowne dane nawet po zamknięciu konta, żeby zbadać przyczynę naruszenia albo się nim zająć.

Historię czatów można usunąć w ustawieniach konta, choć DeepSeek nie podaje w swojej polityce prywatności, ile czasu musi upłynąć, żeby dane zostały wykasowane z serwerów. Zawsze można też wysłać prośbę o usunięcie danych na adres privacy@deepseek.com. Warto jednak pamiętać, że firma może zachować część informacji, jeśli jest to niezbędne z przyczyn prawnych lub w celu zapewnienia zgodności z przepisami.

ChatGPT

Tak jak w przypadku DeepSeek, ChatGPT przechowuje dane osobowe tak długo, jak jest to konieczne do świadczenia usług lub do realizacji uzasadnionych celów biznesowych, np. na potrzeby zapewnienia bezpieczeństwa, rozstrzygania sporów i przestrzegania przepisów. Okres przechowywania zależy od różnych czynników, w tym celu przetwarzania, wrażliwości danych, potencjalnego ryzyka związanego z nieuprawnionym dostępem oraz zobowiązań prawnych.

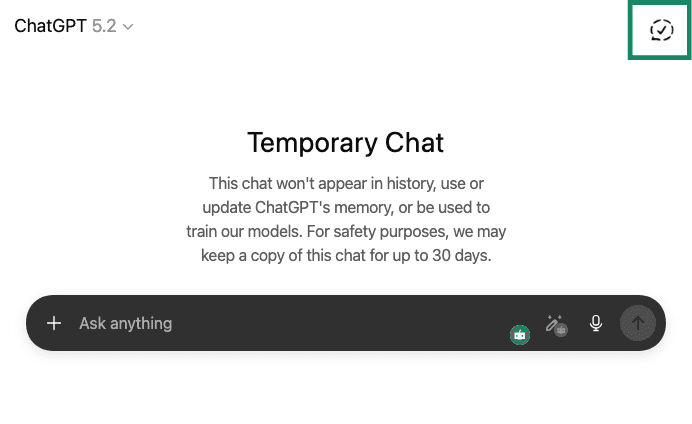

W niektórych przypadkach ustawienia użytkownika mogą wpływać na okres przechowywania. Przykładowo, czaty tymczasowe nie pojawiają się w historii rozmów, ale są przechowywane na serwerach ChatGPT przez okres do 30 dni. To samo dotyczy standardowych czatów, które zostały usunięte z historii przez użytkownika.

Zarządzanie danymi za pośrednictwem Portalu Prywatności ChatGPT.

Portal Prywatności ChatGPT jest dostępny pod adresem privacy.openai.com. Pozwala na składanie formalnych wniosków związanych z danymi osobowymi, w tym o usunięcie, udostępnienie i skorygowanie informacji, a także na egzekwowanie innych praw związanych z ochroną prywatności. Nie mówimy tu jedynie o typowych opcjach dostępnych w aplikacjach, jak usuwanie historii czatu – portal umożliwia przesyłanie zgłoszeń dotyczących prywatności danych bezpośrednio do OpenAI.

Oto lista możliwości, jakie daje Portal Prywatności:

- Usuwanie konta i powiązanych danych osobowych: Przesłanie wniosku o usunięcie konta ChatGPT spowoduje jego trwałe wykasowanie i zainicjowanie procesu wymazania danych z systemów OpenAI – czas oczekiwania to zwykle 30 dni.

- Wniosek o udostępnienie lub skorygowanie danych: Użytkownicy posiadający odpowiednie prawa gwarantowane ustawowo (na przykład na mocy ogólnego rozporządzenia o ochronie danych (RODO) w UE) mogą poprosić o dostęp do swoich danych osobowych lub ich poprawienie.

- Żądanie usunięcia danych osobowych z odpowiedzi generowanych przez ChatGPT: Jeśli odpowiedź ChatGPT zawiera możliwe do zidentyfikowania dane osobowe użytkownika (takie jak imię i nazwisko w połączeniu z wrażliwymi lub prywatnymi szczegółami), użytkownik może przesłać prośbę o ich usunięcie. OpenAI przeanalizuje wniosek i, jeśli go zatwierdzi, podejmie kroki, by zapobiec umieszczaniu wspomnianych danych osobowych w odpowiedziach generowanych w przyszłości. Należy pamiętać, że ta opcja stanowi po prostu dodatkową formę ochrony prywatności i wcale nie oznacza, że ChatGPT przechowuje osobiste profile użytkowników lub zapamiętuje szczegóły na ich temat w rozmowach.

Ogólnie rzecz biorąc, Portal Prywatności stanowi formalny instrument pozwalający na egzekwowanie pełni przysługujących praw związanych z ochroną danych osobowych, jeśli ustawienia dostępne w aplikacji okażą się niewystarczające.

Komercyjne a open-source'owe narzędzia AI: prywatność z założenia w praktyce

Systemy sztucznej inteligencji różnią się konstrukcją, wdrożeniem i sposobem nadzoru. Jednym z najważniejszych rozróżnień jest to między modelami open-source, w których części systemu są publicznie dostępne, a komercyjnymi usługami AI, w których model i infrastruktura są centralnie administrowane przez jednego usługodawcę.

Jak „open-source” wpływa na bezpieczeństwo DeepSeek?

W kontekście sztucznej inteligencji open-source odnosi się do kodu źródłowego, który jest publicznie dostępny. Pozwala to na niezależną inspekcję pod kątem luk w zabezpieczeniach lub niezamierzonego działania kodu, szczególnie w przypadku implementacji polegającej na samodzielnym hostingu.

Model DeepSeek R1 jest dostępny w serwisie GitHub na licencji MIT. Daje to dowolnej osobie możliwość swobodnego, nieograniczonego korzystania, modyfikowania i rozpowszechniania – również w celach komercyjnych.

Z punktu widzenia bezpieczeństwa i prywatności ta forma licencji niesie ze sobą szereg konsekwencji:

- Model nadaje się do samodzielnego hostingu – w takiej sytuacji prompty i wyniki pozostają w całości w lokalnej/prywatnej infrastrukturze.

- Niezależni weryfikatorzy mogą przeprowadzać testy bezpieczeństwa w celu wykrycia luk w zabezpieczeniach.

- Organizacje mogą stosować własne środki na potrzeby kontrolowania dostępu, prowadzenia logów i przestrzegania zgodności z wymogami prawnymi i regulacyjnymi.

Z drugiej strony, open-source’owy charakter nie oznacza w tym przypadku pełnej transparentności w kwestii opracowywania oprogramowania. Wiele systemów sztucznej inteligencji określanych jako open-source nie upublicznia informacji o pochodzeniu, budowie i sposobie wstępnego przetwarzania korpusu treningowego, nawet jeśli kod źródłowy modelu jest jawny. Ogranicza to możliwość niezależnej weryfikacji danych użytych do przeszkolenia modelu i może wpływać na zdolność do oceny prywatności, stronniczości i wiarygodności.

DeepSeek nie ujawnia kompletnych zbiorów danych szkoleniowych, co pokrywa się z ograniczeniami, o których wspomnieliśmy powyżej. Jak widać, transparentność na poziomie kodu źródłowego nie przekłada się z automatu na podobne podejście w przypadku danych szkoleniowych i procesu opracowywania oprogramowania.

Scentralizowana infrastruktura i mechanizmy zaufania w przypadku ChatGPT

ChatGPT wykorzystuje infrastrukturę kontrolowaną przez OpenAI. Użytkownicy wchodzą w interakcję z modelem za pośrednictwem interfejsów sieciowych lub API, a cały proces przetwarzania promptów odbywa się w obrębie systemów obsługiwanych przez OpenAI.

Przedstawia się to następująco:

- OpenAI określa, gdzie i w jaki sposób odbywa się przetwarzanie danych.

- Użytkownicy muszą bazować na udokumentowanych procedurach, a nie na bezpośredniej inspekcji kodu źródłowego.

- Firma centralnie egzekwuje kontrolę bezpieczeństwa, ograniczenia dostępu i monitorowanie.

Ponieważ bazowy model i infrastruktura są zastrzeżone, strony trzecie nie mogą przeprowadzić niezależnego audytu całego systemu. Takie podejście negatywnie wpływa na transparentność, ale pozwala OpenAI ustandaryzować mechanizmy kontroli zabezpieczeń i konsekwentnie stosować je na wszystkich użytkownikach.

Warto zaznaczyć, że firma OpenAI przeszła szereg ocen i przeglądów zgodności, w tym audyty wewnętrzne i zewnętrzne dotyczące bezpieczeństwa i wymogów regulacyjnych.

Zabezpieczenia techniczne: szyfrowanie i kontrola dostępu

Zarówno ChatGPT, jak i DeepSeek wykorzystują szyfrowanie i zarządzania dostępem, by chronić dane użytkowników korzystających z platform. Wspomniane zabezpieczenia służą zminimalizowaniu ryzyka uzyskania nieautoryzowanego dostępu przez osoby trzecie, a niekoniecznie zagwarantowaniu pełnej poufności.

Szyfrowanie przesyłanych i przechowywanych danych

Obie platformy stosują szyfrowanie do ochrony danych użytkowników – zarówno podczas transmisji, jak i na czas przechowywania w systemie.

ChatGPT szyfruje przechowywane dane przy użyciu szyfrowania zgodnego ze standardami branżowymi, tj. 256-bitowego AES (Advanced Encryption Standard). Wszystkie punkty końcowe korzystają z protokołu Transport Layer Security (TLS) w wersji 1.2 lub wyższej, by szyfrować dane przekazywane między użytkownikami, OpenAI i dostawcami usług platformy, co zabezpiecza przesyłane dane przed przechwyceniem z sieci. Za fizyczne bezpieczeństwo infrastruktury odpowiada platforma Microsoft Azure.

DeepSeek szyfruje komunikację między użytkownikami a swoimi serwerami WWW za pomocą protokołu HTTPS (TLS), uniemożliwiając pasywne przechwytywanie przesyłanych danych.

Kontrola dostępu i zabezpieczenia na poziomie konta

Kontrola dostępu określa, kto może uzyskać dostęp do danych użytkownika na platformie i na jakich warunkach. W oficjalnej dokumentacji DeepSeek czytamy, że wyłącznie autoryzowany personel może uzyskać dostęp do serwera i bazy danych za pomocą środków uwierzytelniania i kontroli dostępu.

OpenAI wdraża rygorystyczne mechanizmy kontroli dostępu oparte na zasadach najmniejszych uprawnień oraz rozdziału obowiązków. Dostęp jest przyznawany wyłącznie w zakresie niezbędnym do realizacji celów operacyjnych, zapewniania bezpieczeństwa lub przestrzegania wymogów prawnych, co zresztą jest weryfikowane podczas regularnych przeglądów.

OpenAI informuje również, że stale monitoruje i rejestruje aktywność związaną z uzyskiwaniem dostępu. Logi są gromadzone w sposób scentralizowany i przeglądane w celu wykrycia nietypowej aktywności, a uprawnienia dostępu są okresowo weryfikowane, a jeśli przestają być potrzebne – odbierane. Dostęp do systemów administracyjnych i wewnętrznych wymaga uwierzytelnienia wieloskładnikowego (MFA), a wewnętrzne zmiany dotyczące uprawnień są dokumentowane i weryfikowane.

Ograniczenia szyfrowania w chatbotach AI

Chatboty AI nie używają szyfrowania end-to-end (E2EE). Aby wygenerować odpowiedzi, usługi takie jak ChatGPT i DeepSeek muszą odszyfrować i przetworzyć prompty na własnych serwerach.

To oznacza, że wszystko, co wprowadzasz, może być wykorzystane do użytku wewnętrznego zgodnie z zasadami platformy (na przykład do świadczenia usług, sprawdzania zabezpieczeń, kontroli jakości lub ulepszania modelu, w zależności od tego, jak skonfigurujesz ustawienia). Innymi słowy, choć szyfrowanie chroni dane użytkownika podczas przesyłania i przechowywania, usługodawca wciąż może uzyskać do nich dostęp.

Dlatego też należy w tym przypadku postrzegać szyfrowanie i kontrolę dostępu jako istotne zabezpieczenia, a nie jako narzędzia gwarantujące całkowitą prywatność. Lepiej założyć, że wszystko, co udostępniamy chatbotowi AI, może zostać zapisane lub zweryfikowane zgodnie z polityką usługodawcy.

Zastosowanie w biznesie a hosting

Firmy, które włączają sztuczną inteligencję do swoich przepływów pracy lub udzielają jej dostępu do zastrzeżonych informacji za pośrednictwem interfejsów API, muszą wziąć pod uwagę kwestie izolacji danych, kontroli dostępu, zgodności z przepisami i odpowiedzialności operacyjnej. Wszystko zależy od tego, czy model AI działa na zasadzie hostingu, czy też jest wdrażany w ramach wewnętrznej infrastruktury.

ChatGPT Enterprise: mechanizmy prywatności, nadzoru i izolacji

ChatGPT Enterprise to narzędzie przeznaczone dla organizacji, które chcą korzystać z hostowanej usługi AI, a jednocześnie stosować surowsze mechanizmy nadzoru i ochrony prywatności niż te dostępne w ramach kont konsumenckich.

OpenAI nie używa treści przesłanych za pośrednictwem ChatGPT Enterprise do trenowania modeli. Rozmowy są wyizolowane na poziomie organizacyjnym, a do zarządzania dostępem służy panel administracyjny, a nie indywidualne ustawienia użytkownika. Dzięki temu firmy mogą samodzielnie określać, w jaki sposób sztuczna inteligencja jest wykorzystywana wewnątrz organizacji – nie muszą liczyć na to, że pracownicy sami odpowiednio skonfigurują opcje prywatności.

Z punktu widzenia nadzoru organizacje mogą zarządzać dostępem na poziomie użytkownika, określać zasady użytkowania i monitorować aktywność w zespołach. Takie rozwiązanie ułatwia zachowanie zgodności z wewnętrznymi wymogami i procedurami audytowymi. Mimo wszystko, w tym przypadku OpenAI wciąż centralnie zarządza infrastrukturą, ale wspomniane mechanizmy kontrolne pozwalają firmom ściślej określić granice przetwarzania danych w ramach usługi. Jest to szczególnie istotne w sytuacji, gdy pracownicy wykorzystują ChatGPT jako narzędzie AI do programowania lub do analizy danych (business intelligence AI), ponieważ prompty mogą zawierać zastrzeżone fragmenty kodu, wewnętrzne interfejsy API, projekty systemów lub wrażliwe dane analityczne.

W przypadku ChatGPT Enterprise wciąż mamy do czynienia z hostingiem. Dane są przetwarzane w infrastrukturze zarządzanej przez OpenAI, a organizacje zmuszone są do polegania na procedurach bezpieczeństwa i wewnętrznych mechanizmach kontroli dostępu OpenAI. Różnica polega na sposobie zarządzania danymi oraz ich izolacji na poziomie organizacyjnym, a nie na tym, gdzie lub w jaki sposób obsługiwana jest infrastruktura.

Samodzielny hosting z DeepSeek: korzyści i obowiązki

DeepSeek daje możliwość samodzielnego hostingu w wewnętrznej infrastrukturze organizacji, np. na serwerach lokalnych lub w prywatnej chmurze. W niektórych środowiskach może to przełożyć się na płynniejsze działanie i większą kontrolę nad ochroną prywatności oraz polityką przechowywania danych, a ponadto umożliwia personalizację konfiguracji. Polecenia i dane wyjściowe nie opuszczają sieci organizacji, co ułatwia zarządzanie danymi i minimalizuje kontakt z infrastrukturą innych firm.

Jest to szczególnie istotne dla organizacji działających w branżach podlegających ścisłej regulacji, np. w sektorach finansów, opieki zdrowotnej czy administracji publicznej. Samodzielny hosting pozwoli im skorzystać ze swoich dotychczasowych zabezpieczeń, procesów audytowych i zasad przechowywania danych bezpośrednio w systemie sztucznej inteligencji. Dostęp można ograniczyć za pomocą wewnętrznych systemów identyfikacji tożsamości, a sposób użytkowania można monitorować za pomocą tych samych narzędzi do rejestrowania i nadzoru, które są już stosowane w przypadku innych poufnych zadań.

Warto jednak pamiętać, że samodzielny hosting przenosi odpowiedzialność na organizację. To firma musi odpowiednio zabezpieczyć środowisko, kontrolować dostęp, monitorować użycie, przeprowadzać aktualizacje i zapewniać zgodność z obowiązującymi przepisami i polityką wewnętrzną. Ponadto uruchomienie i dostosowanie modelu może wiązać się z wykorzystaniem znacznych zasobów obliczeniowych, a do tego, w przeciwieństwie do modeli opartych na API, którymi zarządza dostawca, do wdrożenia i utrzymania systemu potrzebna jest specjalistyczna wiedza.

Innymi słowy, skuteczność ochrony prywatności i poziom bezpieczeństwa zależą od tego, jak dobrze organizacja wszystko opracuje i wdroży, a nie od domyślnych mechanizmów kontroli wbudowanych w platformę.

Jak bezpieczniej korzystać z narzędzi AI

ChatGPT, DeepSeek i inne chatboty AI to de facto systemy przetwarzania danych. Wszystko, co do nich wprowadzamy, czy to za pomocą klawiatury, czy głosu, jest przechowywane i rejestrowane, a ponadto może być przeglądane i zapisane na dłużej do celów operacyjnych. To samo dotyczy przesłanych plików. Wszystko to wiąże się zwiększonym ryzykiem ujawienia informacji, szczególnie gdy prompty zawierają dane osobowe, zastrzeżone informacje biznesowe lub treści, które mogą być niewłaściwie wykorzystane w przyszłości.

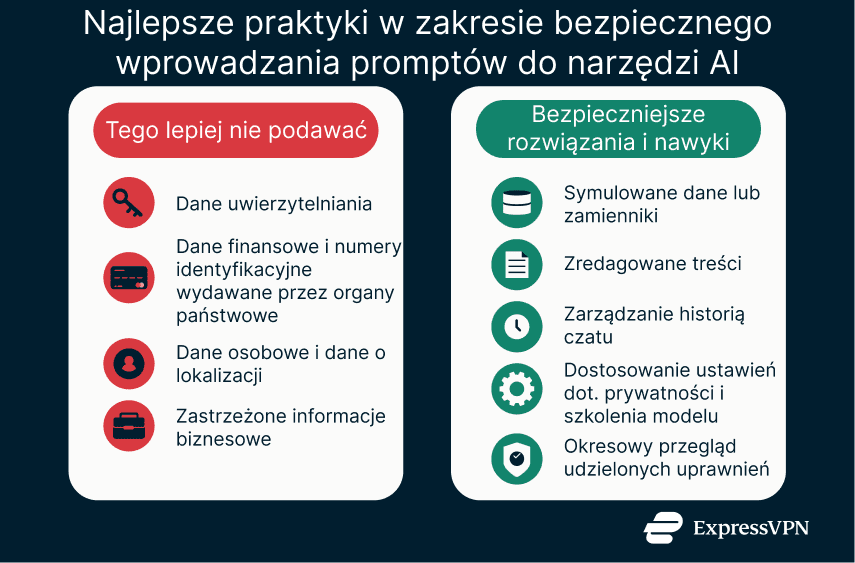

Najlepsze praktyki, dzięki którym unikniemy udostępniania poufnych informacji

Nie należy traktować ChatGPT czy DeepSeek jako przyjaciela lub powiernika. Jeśli czegoś nie powiedzielibyśmy obcej osobie, nie powinniśmy się tym dzielić z chatbotem AI.

- Nie udostępniaj informacji umożliwiających bezpośrednią identyfikację ani danych uwierzytelniania: Nigdy nie wprowadzaj haseł, kodów uwierzytelniających, numerów kart kredytowych, danych bankowych ani numerów identyfikacyjnych wydawanych przez organy państwowe.

- Ostrożnie obchodź się z danymi osobowymi i danymi lokalizacji: Imię i nazwisko w połączeniu z adresem, numerem telefonu lub e-mailem mogą ujawnić więcej, niż byśmy chcieli, szczególnie gdy prompty mają osobisty charakter.

- Z założenia traktuj informacje biznesowe jako poufne: Nie udostępniaj w promptach dokumentów do użytku wewnętrznego, umów, danych finansowych, list klientów i kodu źródłowego, chyba że otrzymasz wyraźną zgodę na takie wykorzystanie narzędzia.

- W miarę możliwości używaj syntetycznych lub zredagowanych danych wejściowych: Jeśli potrzebujesz pomocy w realnej sytuacji, zastąp prawdziwe dane wymyślonymi, ale realistycznymi informacjami. Takie symulowane przykłady pozwolą Ci uzyskać użyteczną odpowiedź bez ujawniania rzeczywistych informacji. Warto podmienić kluczowe szczegóły, takie jak nazwy użytkowników, numery kont lub nazwy systemów wewnętrznych. Pozwoli to istotnie ograniczyć ryzyko, a przy tym nie wpłynie na przydatność prompta.

- Od razu dostosuj ustawienia usługi dotyczące zapisywania danych i wykorzystywania informacji do szkoleń: Wiele narzędzi AI pozwala na usuwanie historii rozmów i wyłączenie możliwości wykorzystania promptów do trenowania modeli. Nie są to jednak ustawienia domyślne. Warto jak najszybciej przejrzeć i dostosować opcje, aby ograniczyć długoterminowe przechowywanie danych i zmniejszyć ryzyko ponownego wykorzystania poufnych promptów.

- Regularnie sprawdzaj uprawnienia i nawyki użytkowania: Narzędzia AI szybko ewoluują, podobnie jak ich ustawienia. Okresowo weryfikuj opcje prywatności, powiązane aplikacje i uprawnienia przeglądarek, aby upewnić się, że zakres udzielonego dostępu jest zgodny ze sposobem, w jaki zamierzasz korzystać z narzędzia. Taki nadzór jest szczególnie ważny na współdzielonych urządzeniach lub w środowiskach zespołowych.

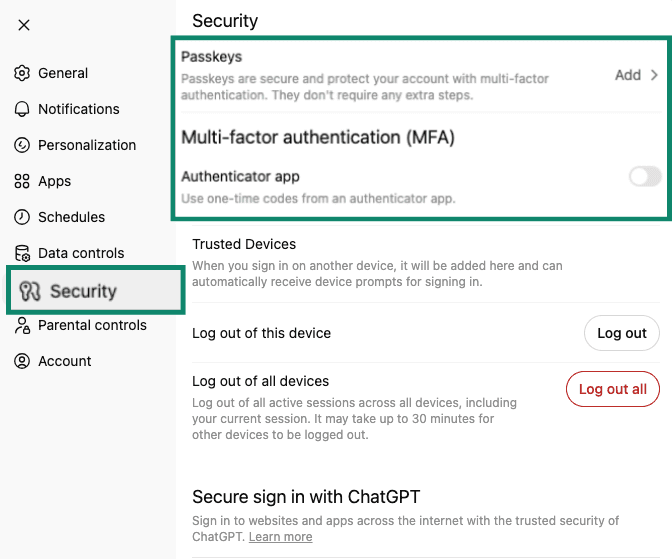

- Zabezpiecz konto silnym hasłem: Historia czatu i sposób wykorzystania narzędzia są powiązane z kontem. Jeśli ktoś przejmie hasło, będzie mógł sprawdzić stare rozmowy i potencjalnie znaczną ilość poufnych danych. Dlatego też warto zabezpieczyć konto długim i silnym hasłem. Jeśli korzystasz z ChatGPT, włącz MFA przy użyciu aplikacji do uwierzytelniania lub kluczy dostępu, aby uniemożliwić nieautoryzowany dostęp (w momencie, gdy przygotowywaliśmy ten artykuł, w DeepSeek nie było takich opcji). Uwaga: MFA i klucze dostępu nie są dostępne dla wszystkich użytkowników ChatGPT: jeśli chcesz sprawdzić, czy możesz korzystać z tych funkcji (i w razie potrzeby je włączyć), przejdź do Settings (Ustawienia) > Security (Bezpieczeństwo).

W jaki sposób VPN może zapewnić lepszą ochronę prywatności podczas korzystania z narzędzi AI?

Korzystanie z wirtualnej sieci prywatnej (VPN) podczas używania ChatGPT wprowadza dodatkową warstwę ochrony na poziomie sieci. VPN szyfruje ruch internetowy, co uniemożliwia osobom trzecim, np. operatorom sieci lub hakerom korzystającym z tej samej Wi-Fi, przechwycenie Twojej aktywności. Zastępuje również IP użytkownika adresem serwera VPN, co ogranicza możliwość pasywnego śledzenia na poziomie połączenia. Jest to szczególnie przydatne, gdy korzystamy z narzędzi AI w publicznych albo niezabezpieczonych sieciach.

Należy jednak pamiętać o ograniczeniach tej metody. Kiedy logujemy się, by korzystać z narzędzia, nasza aktywność pozostaje powiązana z kontem – niezależnie od tego, czy mamy połączenie z VPN. VPN nie ukrywa promptów przed firmą udostępniającą model AI ani nie blokuje platformie możliwości przetwarzania i przechowywania wprowadzanych danych. Z VPN łączymy się po to, by uniemożliwić przejęcie danych przez strony trzecie, co jest szczególnie istotne przy pracy zdalnej i w podróży.

Z kolei w środowiskach korporacyjnych sieci VPN są często używane wraz z firmowymi implementacjami sztucznej inteligencji lub modelami hostowanymi samodzielnie, by zapewnić wielowarstwową ochronę. W przeciwieństwie do komercyjnych VPN, które służą do anonimizacji ruchu internetowego indywidualnych użytkowników, VPN o przeznaczeniu korporacyjnym są zazwyczaj częścią własnej sieci organizacji. Umożliwiają wewnętrzny routing, przyznawanie dostępu na podstawie tożsamości i egzekwowanie scentralizowanej polityki. Taka konfiguracja ogranicza ekspozycję poprzez limitowanie przepływu ruchu związanego z wykorzystaniem AI. Dzięki temu prompty zawierające wrażliwe informacje nie opuszczają kontrolowanego środowiska sieciowego.

FAQ: Często zadawane pytania dot. DeepSeek i ChatGPT

Czy ChatGPT szkoli się na podstawie rozmów z użytkownikami?

W bezpłatnej wersji oraz w ramach subskrypcji Plus i Pro ChatGPT może wykorzystywać konwersacje z użytkownikami do ulepszania modeli w zależności od ustawień konta. Użytkownicy mogą wycofać zgodę na wykorzystanie danych w wyżej wspomnianych celach, przechodząc do ustawień prywatności. W przypadku kont biznesowych i korporacyjnych ChatGPT nie wykorzystuje konwersacji do szkolenia modeli.

Czy którekolwiek z tych narzędzi może być wykorzystywane do przetwarzania informacji poufnych lub danych podlegających regulacji?

ChatGPT Enterprise zapewnia kontrolę nad nadzorem i wykorzystaniem danych służbowych, podczas gdy DeepSeek oferuje opcję samodzielnego hostingu, co sprawia, że dane nie opuszczają wewnętrznych systemów firmy. Jeśli chodzi o kwestie zgodności z przepisami i regulacjami w organizacji, wprowadzanie wrażliwych informacji do narzędzi AI zwykle wymaga stosowania się do polityki spółki, uzyskania akceptacji stosownych działów i wykorzystania wewnętrznych mechanizmów kontroli.

Czy używanie VPN w połączeniu z chatbotem AI jest bezpieczne?

Korzystanie z VPN z chatbotami AI jest bezpieczne i nie zakłóca działania tych narzędzi. VPN wpływa na połączenie sieciowe poprzez szyfrowanie ruchu i maskowanie adresu IP, ale nie zmienia sposobu, w jaki usługodawca AI przetwarza, przechowuje lub odczytuje prompty. VPN należy traktować jedynie jako dodatkowy środek ochrony prywatności, a nie mechanizm zapewniający kontrolę nad chatbotem.

Zrób pierwszy krok, aby chronić się online. Wypróbuj ExpressVPN bez ryzyka.

Pobierz ExpressVPN